谷歌Gemma 3 AI大模型发布:低成本死磕DeepSeek!

谷歌Gemma 3 AI大模型发布:低成本死磕DeepSeek!

谷歌昨晚正式推出全新 AI 大模型 Gemma 3,该模型凭借其在低成本运行方面的显著优势,剑指行业热门模型 DeepSeek!

据谷歌官方介绍,Gemma 3 专为开发者打造,支持在手机、工作站等多种设备上运行,具备分析文本、图像及短视频的能力,覆盖超过 35 种语言,并对 140 多种语言提供预训练支持。

谷歌更是自信宣称,Gemma 3 为 “世界上最好的单加速器模型”,在仅配备单个 GPU 的主机上,性能表现超越 Facebook 的 Llama、DeepSeek 以及 OpenAI 等竞争对手,且已针对 Nvidia 的 GPU 和专用人工智能硬件完成优化。

值得一提的是,Gemma 3 提供 10 亿、40 亿、120 亿和 270 亿参数四种不同版本。其中,参数量最大的 270 亿版本仅需一张 H100 显卡,即可实现高效推理,相比之下,同类模型若要达到类似效果,往往至少需要提升 10 倍算力,这使得 Gemma 3 成为目前性能最强的小参数模型之一。

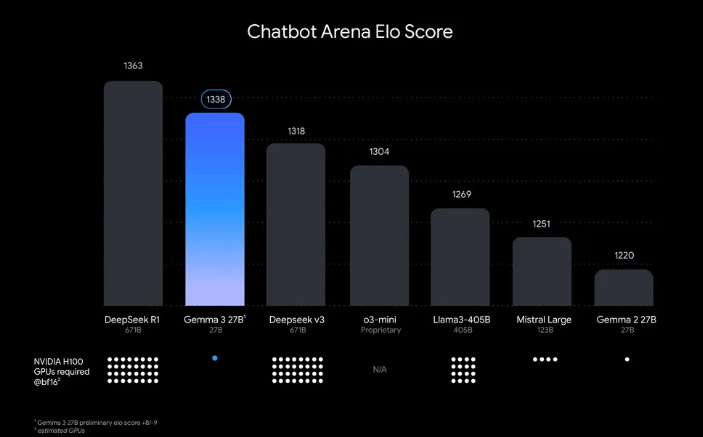

在性能测试环节,根据 LMSYS ChatbotArena 的盲测数据,Gemma 3 的表现仅次于 DeepSeek 的 R1 – 671B,优于 OpenAI 的 o3 – mini 和 Llama3 – 405B 等知名模型。架构设计上,Gemma 3 延续前两代的通用解码器 Transformer 架构,同时进行了诸多创新优化。例如,为解决长上下文导致的内存占用问题,它采用局部和全局自注意力层交错的架构,每 5 个局部层之间插入 1 个全局层,局部层跨度仅 1024 个 token,通过这种方式有效降低内存占用。

多模态能力同样是 Gemma 3 的一大亮点,其集成定制版的 SigLIP 视觉编码器,基于 Vision Transformer 架构,通过 CLIP 损失的变体训练,可同时处理文本和图像。

为进一步评估 Gemma 3 性能,谷歌在 MGSM、Global – MMLU – Lite、WMT24++、RULER、MRCR 等多个主流平台展开测试。结果显示,Gemma 3 在多模态任务中表现突出,在 DocVQA、InfoVQA 和 TextVQA 等任务里,性能大幅超越前代模型;长文本处理方面,270 亿参数版本的 Gemma 3 在 RULER128K 任务上,准确率达到 66.0% 。

此外,谷歌还推出基于 Gemma 3 基础的 4B 图像安全检查器 ShieldGemma 2,为图像安全提供现成解决方案,可输出危险内容、色情内容和暴力内容三类安全标签。

同时,谷歌发布 Gemma 3 学术计划,学术研究人员能够申请价值 10000 美元的谷歌云积分,用于推进基于 Gemma 3 的研究工作。

更多消息请守住 Mdroid。

来源:谷歌